ChatGPTとGoogleのGeminiは、優れた大規模言語モデルを競う中で主要な力として浮上している。これらのプラットフォームがAI業界を変革したことは明らかである。しかし、情報の取得方法やデータセットの管理については、継続的な倫理的懸念が存在する。

BeInCryptoは18日、ChainGPT、Space ID、Sapien.io、Vanar Chain、O.XYZ、AR.IO、Kindredなど新興AIプロジェクトと、知的財産権、著作権、所有権の懸念について議論した。主題は、分散型人工知能(deAI)が有望な代替手段である可能性となった。

LLMの台頭とデータ取得のジレンマ

その創造以来、大規模言語モデル(LLM)は急速に広く使用されるようになった。多くの点で、OpenAIのChatGPTやGoogleのGeminiのようなプラットフォームは、一般の人々が人工知能(AI)の能力とその無限の利用可能性に初めて触れる機会となった。

しかし、これらの企業はその運営方法についても批判を受けている。競争力を維持するためには、AIモデルは大量のデータセットにアクセスする必要がある。LLMは、大量のテキストを処理することで初めて、人間のような応答を生成し、複雑なクエリを理解することができる。

これを実現するために、OpenAI、Google、Meta、Microsoft、Anthropic、Nvidiaなどの主要なテクノロジー企業は、インターネット上のすべての利用可能なデータと情報をAIモデルの訓練に活用している。このアプローチは、これらのプラットフォームが取り込む入力と、それを出力として再現する際の所有権について深刻な疑問を投げかけている。

AIの破壊的な可能性にもかかわらず、知的財産権に関する懸念は激しい法的闘争に発展している。

AI企業、盗用コンテンツで帝国構築?

急速なAIの採用は、データの所有権、プライバシー、そして潜在的な著作権侵害に関する懸念を引き起こしている。重要な争点は、著作権で保護された資料を使用して、中央集権的なAIモデルを訓練することだ。これらのモデルは大企業が独占的に管理している。

“AI企業は、クリエイターの許可を得ずに彼らの作品を利用して帝国を築いている。作家、アーティスト、ミュージシャンは何年もかけて自分の技術を磨いてきたが、AIモデルが数秒で模倣版を生成するためにその作品が取り込まれていることに気づく。” – ジャワド・アシュラフ、Vanar Chain CEOがBeInCryptoに語った。

この問題は確かに広範な不満を引き起こしている。Vanar ChainのCEOは、OpenAIなどが著作権で保護された資料をスクレイピングしていることを公然と認め、訴訟やデータ倫理に関する広範な再評価を引き起こしていると付け加えた。

“問題の核心は補償にある。AI企業は、公開されているデータをスクレイピングすることは正当だと主張するが、クリエイターはそれを白昼の強盗と見なしている。” – アシュラフ氏が述べた。

AI生成作業の境界定義

ニューヨーク・タイムズは2023年12月にOpenAIとMicrosoftを相手取り、著作権侵害と知的財産の無断使用を訴える訴訟を起こした。

タイムズは、MicrosoftとOpenAIが「タイムズの独自の価値ある作品の違法なコピーと使用」に基づくビジネスモデルを構築していると非難した。また、これらのモデルが「それらの作品に含まれる著作権で保護された表現の大部分を利用し、場合によっては保持している」と主張した。

4か月後、6つの異なる米国の州で運営されている8つのニュース出版社が、著作権侵害でMicrosoftとOpenAIを訴えた。

シカゴ・トリビューン、デンバー・ポスト、カリフォルニアのマーキュリー・ニュース、ニューヨーク・デイリーニュース、カリフォルニアのオレンジカウンティ・レジスター、オーランド・センティネル、ミネソタのパイオニア・プレス、フロリダのサン・センティネルは、2つのテクノロジー企業がAI製品で無断で記事を使用し、不正確な情報を誤って帰属させたと主張した。

“裁判所は、数年前には存在しなかった質問に答えなければならない状況に直面している。AI生成コンテンツは派生作品と見なされるのか?データが無断で使用された場合、著作権者は損害賠償を請求できるのか?” – トレバー・コヴェルコ、Sapien.io共同創設者がBeInCryptoに語った。

ジャーナリズム組織に加えて、出版社、作家、ミュージシャン、その他のコンテンツクリエイターも、これらのテクノロジー企業に対して著作権情報に関する法的措置を開始している。

業界横断の法廷闘争

先週、3つの業界団体が、Metaが「著作権で保護された作品を無断で大量に使用した」として、パリの裁判所でMetaを訴えると発表した。これにより、Metaの生成AIを活用したチャットボットアシスタントがFacebook、Instagram、WhatsAppで使用されている。

一方、ビジュアルアーティストのサラ・アンダーセン、ケリー・マッケルナン、カーラ・オルティスは、AIアートジェネレーターのStability AI、DeviantArt、Midjourneyを彼らの作品をAIモデルの訓練に使用したとして訴えた。

“中央集権的なAI企業によるデータと創造的な素材の無規制使用に関する懸念は尽きない。現在、公開されている素材を持つアーティスト、作家、ミュージシャンは、AIアルゴリズムによって作品がクロールされ、ほぼ同一のコンテンツを生成し、利益を得ることができるが、アーティストは何も得られない。” – フィル・マタラス、AR.IO創設者が主張した。

OpenAIとGoogleは特に、法律が著作権で保護された資料へのアクセスを制限する場合、アメリカは中国に対してAI競争で負けると主張している。彼らによれば、中国の企業は規制の制約が少なく、競争相手に重要な優位性を与えている。

これらの大手企業は、著作権で保護されたデータに基づくAIの訓練を「フェアユース」として分類するよう、米国政府に積極的にロビー活動を行っている。彼らは、AIが著作権で保護されたコンテンツを処理することで、元の資料とは根本的に異なる新しい出力が生まれると主張している。

しかし、生成AIツールがますますテキスト、画像、声を生成するようになるにつれ、多くの業界がこれらの企業に対して法的な挑戦を追求している。

「コンテンツクリエイター、つまり著者、音楽家、ソフトウェア開発者は、しばしば自分たちの[知的財産]がフェアユースを超える方法で使用されていると言う。特にAIシステムが彼らのオリジナル作品の側面をコピーまたは再現する場合において」と、O.XYZの創設者兼CEOであるアフマド・シャディッド氏は述べた。

一方、Web3では、プレイヤーがLLM開発に対する従来の企業のアプローチに代わるものを求めてロビー活動を行っている。

DeAI、Web3の代替案浮上

分散型AI(deAI)はWeb3の新興分野であり、ブロックチェーンと分散型台帳技術を使用して、より民主的で透明性のあるAIシステムを作成することを探求している。

「DeAIは、ブロックチェーンと分散型台帳技術を活用して、データ所有権と著作権の懸念に対処し、より透明なAIシステムを作成することを目指している。AIモデルの開発と制御をグローバルネットワーク全体に分散させ、コンテンツクリエイターの権利を尊重する公正なAI訓練モデルを確立する。DeAIはまた、AI訓練に使用される作品のクリエイターに対して公平な報酬を提供するメカニズムを提供し、集中型AIモデルに関連する多くの問題を解決する可能性がある」と、KindredのCEO兼創設者であるマックス・ジャマリオ氏は説明した。

AIの世界的な重要性が増す中、ブロックチェーンとの融合は両方の分野を変革し、暗号資産の革新と投資の新しい道を開くことが期待されている。

これに応じて、業界の開発者はすでにAIとWeb3技術を融合させた成功したプロジェクトを開発し始めている。

集中型AIモデルを生産する企業とは異なり、deAIは完全にオープンソースであることを目指している。

OpenAIは以前、著作権で保護された資料を使用してAIモデルを訓練しているにもかかわらず、米国のフェアユース原則に準拠していると主張していた。さらに、ChatGPT、その最も人気のあるアプリケーションは完全に無料で使用できる。

スペースIDの事業開発ディレクターであるハリソン・セレツキー氏は、OpenAIの主張に矛盾があると指摘した。

「明らかな倫理的問題は、クリエイターの明示的な許可なしに資料が使用されていることだ。著作権がある場合、許可が必要であり、通常は料金が支払われるべきだ。しかしそれを超えて、たとえChatGPTのようなLLMがオープンソースデータを使用しても、OpenAIのモデルはオープンソースではない。彼らは公に利用可能な資料を使用しているが、完全に『返す』ことはしていない。

ここには、AIがオープンソースであるべきかどうかという大きな疑問がある。OpenAIのChatGPTはそうではないが、中国のDeepSeekや分散型AIのモデルはそうである。倫理と知的財産権の観点から見ると、後者が確かにより良い選択だ」とセレツキー氏は述べた。

これらの技術大手の集中管理は、AIモデルの実装と監視に関する他の懸念も引き起こしている。

中央集権型 vs 分散型:倫理と運用の違い

deAIのコミュニティ主導の性質とは対照的に、集中型AIモデルは少数の人々によって構築されているため、潜在的なバイアスが生じる可能性がある。

「集中型AIは通常、単一の企業の傘下で運営され、決定はトップダウンの利益動機によって駆動される。それは本質的に一つのエンティティによって所有され管理されるブラックボックスだ。それに対して、DeAIはコミュニティ主導のアプローチに依存している。AIはコミュニティのフィードバックを分析し、企業の利益だけでなく集団の利益のために最適化されるように設計されている」と、O.XYZの創設者兼CEOであるアフマド・シャディッド氏は説明した。

一方、ブロックチェーン技術は収益化の明確な道を提供している。

「クリエイターは自分の創造的な資産、例えば記事、音楽、あるいはアイデアをトークン化し、自分の価格を設定できる。これにより、知的財産のクリエイターとユーザーの両方にとってより公正な環境が生まれ、IPの自由市場を形成する。さらに、ブロックチェーン上のすべてが透明で不変であるため、他人が誰かの作品を不正に利用することがはるかに難しくなる」とセレツキー氏はBeInCryptoに語った。

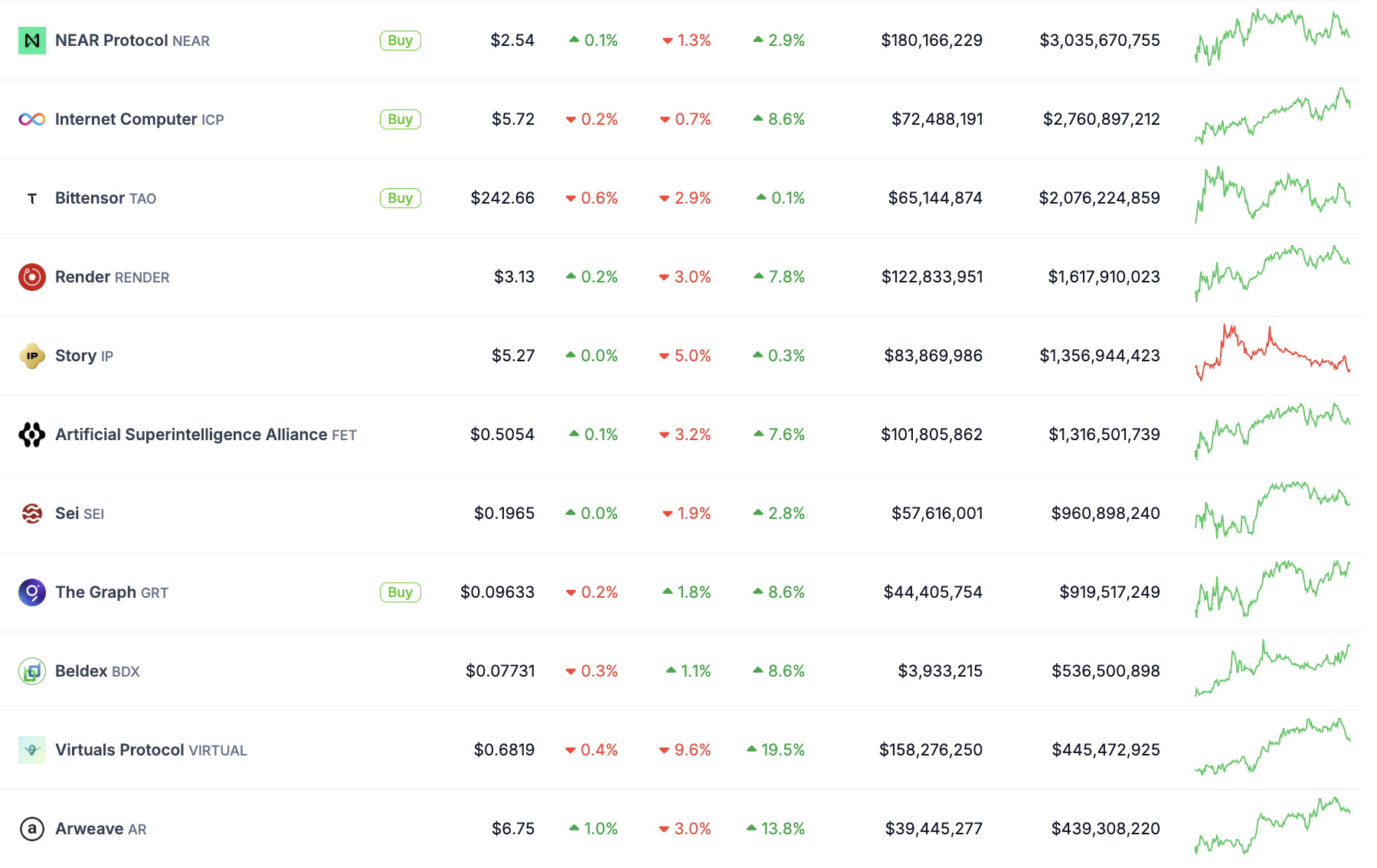

異なるWeb3の開発者はすでに、生成AIに使用されるコンテンツを分散化するプロジェクトを開発している。Story、Inflectiv、Arweaveのようなプラットフォームは、AIモデルに使用されるデータセットが倫理的にキュレーションされることを保証するために、ブロックチェーン技術のさまざまな側面を活用している。

ChainGPTの創設者であるイラン・ラフマノフ氏は、deAIを集中型AIに対する重要な対抗勢力と見なしている。同氏は、既存のAI独占企業の非倫理的な慣行に対処することが、将来の健全な業界の育成に不可欠であると主張している。

「これは、AI企業が著作権で保護されたコンテンツを適切な帰属や支払いなしに自由に使用できる危険な前例を作る。法的には規制の監視を招き、倫理的にはクリエイターからのコントロールを奪う。ChainGPTはオンチェーンでの帰属と収益化を信じており、AIユーザー、貢献者、モデルトレーナーの間で公正な価値交換を保証する」ラフマノフ氏が述べた。

しかし、DeAIが中心的な役割を果たすためには、いくつかの障害を克服する必要がある。

deAIの障害は何か?

deAIは成長の可能性を秘めているが、まだ初期段階にある。その点で、OpenAIやGoogleのような企業は経済力とインフラにおいて優位に立っている。彼らは大量のデータを取得するために必要な膨大なリソースを扱う手段を持っている。

「中央集権型AI企業は膨大な計算能力にアクセスできるが、deAIは効率的で分散型のネットワークをスケールする必要がある。そしてデータだ。中央集権型モデルは蓄積されたデータセットで繁栄するが、deAIは信頼できるパイプラインを構築し、貢献者に公正に報酬を支払う必要がある」コヴェルコ氏がBeInCryptoに語った。

その点について、アフマド・シャディッド氏は次のように付け加えた。

「分散型台帳上でAIシステムを構築し運用することは複雑であり、特に大規模なデータを扱う場合はそうだ。また、AIの学習プロセスをコミュニティの倫理と目標に合わせるための慎重な監視が必要だ」

これらの技術的な大手企業は、リソースとコネクションを利用して、deAIのような競争相手に対抗するためのロビー活動を行うこともできる。

「彼らは中央集権型モデルを支持する規制を提唱し、市場の支配力を利用して競争を制限し、AI開発に必要な重要なリソースをコントロールすることでそうするかもしれない」ジャマリオ氏が述べた。

アシュラフ氏にとって、これが起こる可能性は当然のこととされるべきだ。

「ビジネスモデル全体がデータを蓄積し、それを秘密裏に収益化することに基づいている場合、オープンで透明な代替案は最後に望むものだ。AIの大手企業がDeAIに対抗するためにロビー活動を行い、制限的な規制を推進し、分散型の代替案を信用失墜させるために膨大なリソースを使用することを期待する。しかし、インターネット自体は企業が支配する前は分散型システムとして始まり、中央集権型コントロールの欠点に人々は目覚めている。オープンAIのための戦いは始まったばかりだ」ジャワド・アシュラフ、ヴァナーチェーンCEOが予測した。

しかし、DeAIの使命をさらに進めるためには、Web3ユーザーとその外の人々の両方に対して、公共の認知度を高める必要がある。

知識のギャップを埋める

現在DeAIが直面している主な障害について尋ねられたとき、Space IDのセレツキー氏は、AIモデルにおける著作権侵害の問題を解決するためには、人々がその問題を認識する必要があると述べた。

「主な障害は教育の欠如だ。ほとんどのユーザーはデータがどこから来ているのか、それがどのように分析され、誰がそれをコントロールしているのかを知らない。多くの人はAIが人間と同じように偏見を持っていることさえ気づいていない。これを理解する前に、平均的な人々にこのことを教育する必要がある」同氏が述べた。

一度、一般の人々が中央集権型AIモデルにおける著作権問題を理解すれば、DeAIの支持者はDeAIの強力な代替案としての利点を積極的に示す必要がある。しかし、認識が高まっても、DeAIは依然として採用の課題に直面している。

「採用はもう一つの課題だ。企業は即時使用可能なAIソリューションに慣れており、DeAIはそのレベルのアクセス性を提供しつつ、セキュリティ、透明性、革新性の利点を証明する必要がある」コヴェルコ氏が述べた。

今後の道:規制の明確化と信頼

教育とアクセス性の課題が解決されれば、DeAIの広範な採用への道は、規制の明確化と公共の信頼の構築にかかっている。Sapien.ioの共同創設者であるトレバー・コヴェルコ氏も、DeAIがこれらの目標を達成するためには、規制の明確化が必要だと付け加えた。

「明確な枠組みがなければ、DeAIプロジェクトは法的な不確実性によって脇に追いやられるリスクがある一方で、中央集権型のプレイヤーはその支配を有利にする政策を推進する。これらの課題を克服するには、技術を洗練し、現実世界での価値を証明し、オープンで民主化されたAIを推進する運動を構築することが必要だ」と同氏は主張した。

シャディッド氏は、より大きな公共の信頼を構築することとともに、より大きな制度的支援が必要であることに同意した。

「透明性は、何十年もかけて独自の方法を完璧にしてきた場合、不安を引き起こす可能性があるため、DeAIは信頼と革新性の点でその優位性を証明しなければならない。もう一つの障害は、十分なユーザーの信頼と規制の明確化を構築し、人々や政府がデータの取り扱いに安心感を持てるようにすることだ。最も効果的な方法は、分散型AIがその中央集権型の対抗者を明らかに上回るか、少なくとも速度、コスト、品質の面で匹敵しながら、よりオープンで公正であることを実証する現実世界のユースケースを示すことだ」アフマド・シャディッド氏が説明した。

最終的に、AIモデルに関する著作権の懸念は、知的財産を尊重し、より民主的なAIエコシステムを促進することに焦点を当てたパラダイムシフトを求めている。DeAIの最終的な影響に関係なく。